王小川旗下百川智能今日宣布发布大模型产品 Baichuan-53B,官方表示,“Baichuan-53B 大模型目前在写作、文本创作能力方面,已经达到行业最好的水平”。

Baichuan-53B 定位“闭源大模型”,目前并没有在 GitHub、HuggingFace 处公布相关信息。

“Baichuan-53B 主要面向 B 端用户提供服务,发布后,该大模型也将启动内测,预计下个月将会开放 API 等相关组件”。

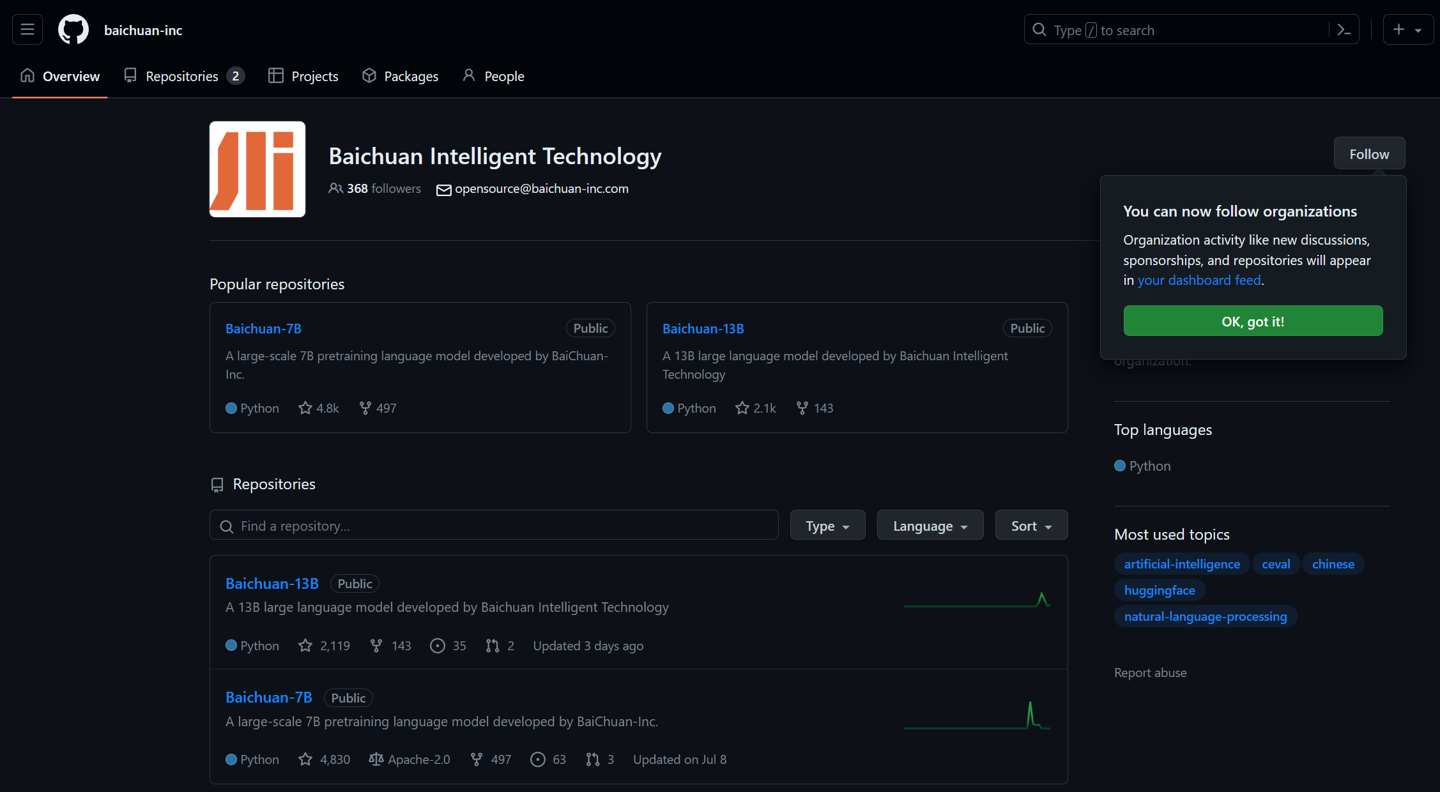

百川智能已经发布了 Baichuan-7B、Baichuan-13B 两个通用大语言模型,感兴趣的小伙伴们可以在 GitHub 中找到相关内容。

Baichuan-7B 是一个 70 亿参数量的中英文预训练大模型,在 C-Eval、AGIEval 和 Gaokao 三个最具影响力的中文评估基准进行了综合评估,并且均获得了优异成绩,它已经成为同等参数规模下中文表现最优秀的原生预训练模型。

Baichuan-13B 是由百川智能继 Baichuan-7B 之后开发的包含 130 亿参数的开源可商用的大规模语言模型,在中英文 Benchmark 上均取得同尺寸模型中最好的效果。

数据统计

数据评估

关于百川智能特别声明

本站ChatGPT大全提供的百川智能都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由ChatGPT大全实际控制,在2023年8月8日 下午8:16收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,ChatGPT大全不承担任何责任。