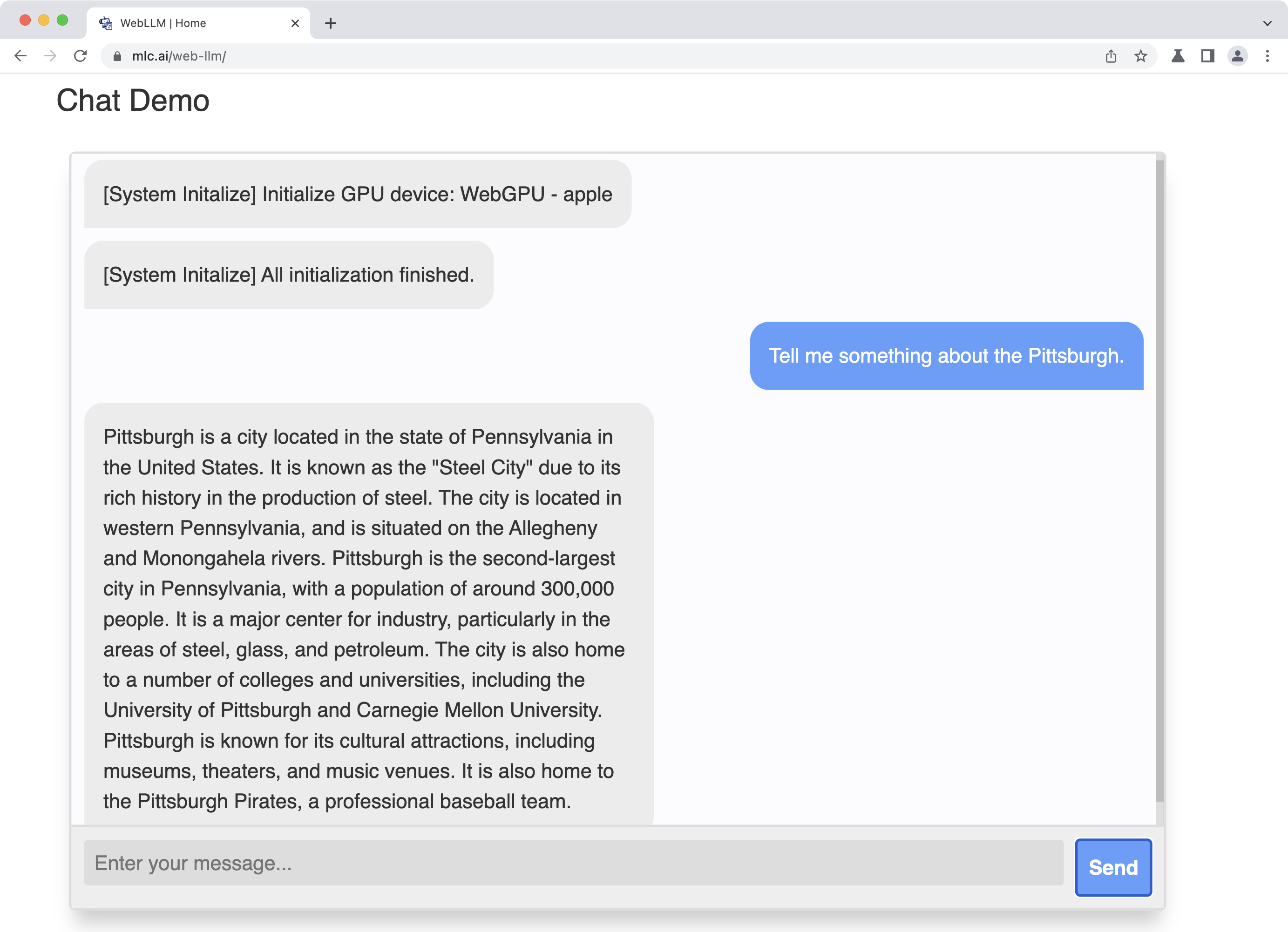

该项目将大语言模型和基于LLM的聊天机器人引入Web浏览器。一切都在浏览器中运行,没有服务器支持,并使用 WebGPU 加速。这为每个人构建 AI 助手提供了许多有趣的机会,并在享受 GPU 加速的同时实现隐私。请查看我们的 GitHub 存储库,看看我们是如何做到的。还有一个演示,您可以尝试一下。

我们最近在生成式AI和LLM方面取得了惊人的进展。感谢像LLaMA,Alpaca,Vicuna和Dolly这样的开源努力,我们开始看到构建自己的开源语言模型和个人AI助手的令人兴奋的未来。

这些模型通常很大且计算量很大。要构建聊天服务,我们需要一个大型集群来运行推理服务器,而客户端则向服务器发送请求并检索推理输出。我们通常还必须在特定类型的GPU上运行,在这些GPU上,流行的深度学习框架很容易获得。

这个项目是我们为生态系统带来更多多样性的一步。具体来说,我们可以简单地将LLM直接烘焙到客户端并直接在浏览器中运行它们吗?如果能够实现这一点,我们可以为客户的个人人工智能模型提供支持,从而降低成本、增强个性化和隐私保护。客户端变得非常强大。

如果我们能简单地打开一个浏览器,直接将AI原生地带到你的浏览器标签上,那不是更令人惊讶吗?生态系统中有一定程度的准备。该项目为这个问题提供了肯定的答案。

指示

WebGPU刚刚发布到Chrome,处于测试阶段。我们在Chrome Canary中进行实验。您还可以尝试最新的Chrome 113。不支持Chrome版本≤ 112,如果您正在使用它,演示将引发错误,例如我们已经在Windows和Mac上对其进行了测试,您将需要一个具有约6.4G内存的GPU。Find an error initializing the WebGPU device OperationError: Required limit (1073741824) is greater than the supported limit (268435456). - While validating maxBufferSize - While validating required limits.

如果您有一台装有 Apple 芯片的 Mac 计算机,以下是在本地浏览器上运行聊天机器人演示的说明:

- 安装 Chrome Canary,这是 Chrome 的开发者版本,支持使用 WebGPU。

- 启动Chrome Canary。建议您使用以下命令从终端启动(或将Chrome Canary替换为Chrome):

/Applications/Google\ Chrome\ Canary.app/Contents/MacOS/Google\ Chrome\ Canary --enable-dawn-features=disable_robustness此命令会关闭 Chrome Canary 的稳健性检查,这会减慢图像生成速度。这不是必需的,但我们强烈建议您使用此命令启动 Chrome。

- 输入您的输入,单击“发送” – 我们准备好了!聊天机器人将首先将模型参数提取到本地缓存中。下载可能需要几分钟,仅在第一次运行时。后续刷新和运行速度会更快。

数据统计

数据评估

本站ChatGPT大全提供的Web LLM都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由ChatGPT大全实际控制,在2023年4月20日 下午12:18收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,ChatGPT大全不承担任何责任。