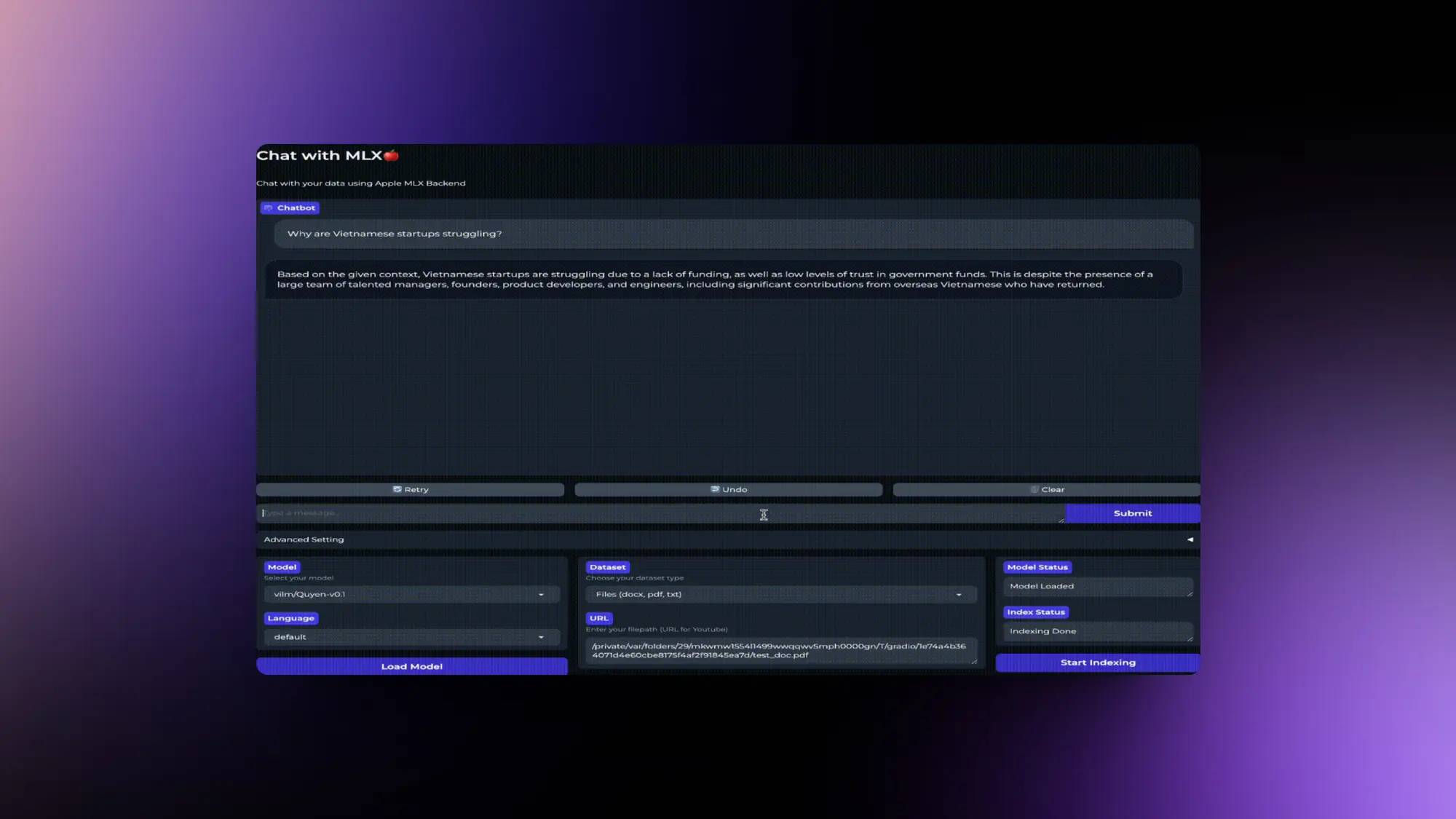

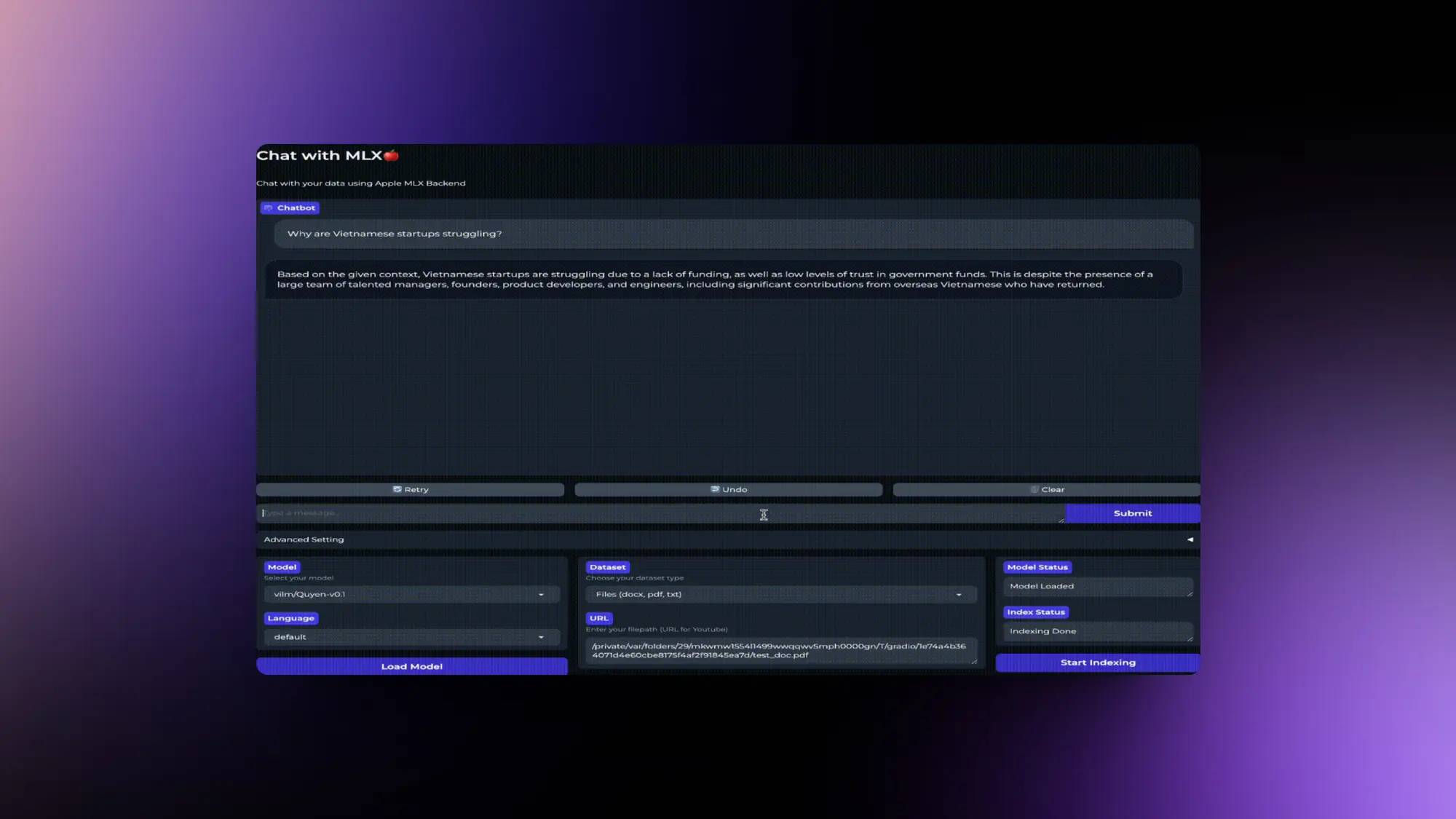

Chat-with-mlx:本地LLM运行程序

受NVIDIA’s Chat with RTX启发做的项目chat-with-mlx。

支持自动下载本地模型,并且可以同本地文件进行交互,支持多种语言,包括英语、西班牙语、中文和越南语。

该项目的一个关键特点是易于集成,用户可以轻松集成任何HuggingFace和MLX兼容的开源模型。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

受NVIDIA’s Chat with RTX启发做的项目chat-with-mlx。

支持自动下载本地模型,并且可以同本地文件进行交互,支持多种语言,包括英语、西班牙语、中文和越南语。

该项目的一个关键特点是易于集成,用户可以轻松集成任何HuggingFace和MLX兼容的开源模型。