Mistral AI开源MoE模型Mixtral-8x7b

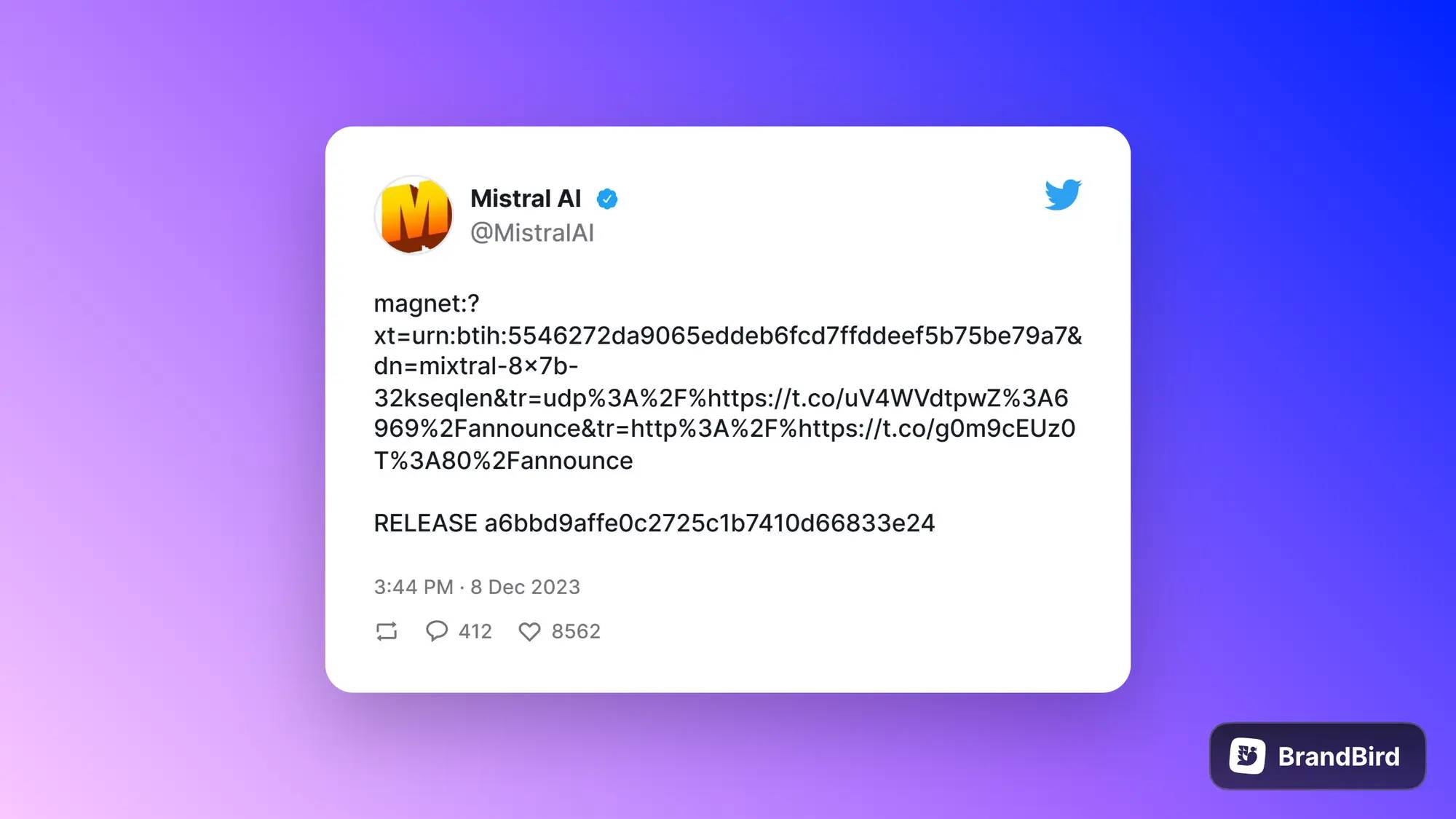

8号的晚上Mistral AI的推特突然放出了一个磁力链接,下载下来以后是一个87G的模型文件。

Mistral AI 成立于 2023 年 5 月,是一家法国人工智能初创公司,也是为数不多来自欧洲的大模型开源领域的明星团队。

Shubham Saboo 总结了 Mixtral-8x7b 已知的一些信息,以及MoE架构是什么还有就是这个MoE架构和GPT-4传言的MoE架构有什么区别。

- 该模型以 87 GB 的种子文件形式发布。

- 可以比喻为 GPT-4 的精简版。

- 在 X 平台发布,没有配套的新闻发布会,且对更多细节守口如瓶。

谷歌凭借其精心编排的演示视频令 AI 社区敬畏,但现在这段视频正受到广泛批评。

另一方面,开源 AI 创业公司 Mistral AI 发布了一个包含 8 个 7B 级别专家的 MoE 模型。

专家混合模型(MoE)是什么?

专家混合(MoE)是用于提高大语言模型效率和准确度的技术。这种方法将复杂任务划分为更小、更易管理的子任务,每个子任务由专门的小型模型或“专家”负责。

以下是简要说明:

- 专家层:这些是在特定领域训练有素的小型神经网络。每个专家以其独特专长的方式处理相同的输入。

- 门控网络:这是 MoE 架构的决策核心。它判断哪个专家最适合处理特定输入。网络为输入数据与每个专家的兼容性打分,然后根据这些得分确定每个专家在任务中的角色。

这些组成部分共同确保正确的专家处理正确的任务。门控网络有效地将输入引导至最合适的专家,而专家则专注于他们擅长的领域。这种合作培训使得整体模型更加多才多艺、能力更强。

关于 Mistral 新 MoE 的详情(来自 Reddit) 在对每个 Token 进行推理时,只有 2 个专家被使用。

这一信息可以从模型的元数据中获得:

{“dim”: 4096, “n_layers”: 32, “head_dim”: 128, “hidden_dim”: 14336, “n_heads”: 32, “n_kv_heads”: 8, “norm_eps”: 1e-05, “vocab_size”: 32000, “moe”: {“num_experts_per_tok”: 2, “num_experts”: 8}

与 GPT-4 的比较Mistral 的 8x7B 模型采用了与 GPT-4 相似的架构,但规模更小:

◆总共 8 个专家模型,而不是 16 个(减少了一半)

◆每个专家拥有 7B 参数,而不是 166B(减少了 24 倍)

◆总共约 42B 参数,而非 1.8T(减少了 42 倍)

◆与原版 GPT-4 相同的 32K 上下文限制

你现在可以在Poe或者Perplexity体验部署好的 Mixtral-8x7b 模型:https://labs.perplexity.ai/

© 版权声明

文章版权归作者所有,未经允许请勿转载。