DALL-E3向所有Plus用户开放,公布了训练论文

Open AI向所有ChatGPT Plus 和 Enterprise 用户开放了DALL-E3的使用权限,同时还公布了两篇论文,一篇《通过更好的提示改进图像生成》大致介绍了DALL-E3的训练方法,另一篇《DALL·E 3 System Card》大致介绍了他们是如何保证DALL-E3的安全的。

《通过更好的提示改进图像生成》基本上 阐述了他们DALL-E3主要解决的问题是Diffusion模型中由于训练数据集中图像标题的噪声和不准确性导致的图像生成可控性不够强的问题,解决方式是训练了一个定制的图像提示生成器,并使用它重新为训练数据集生成提示。

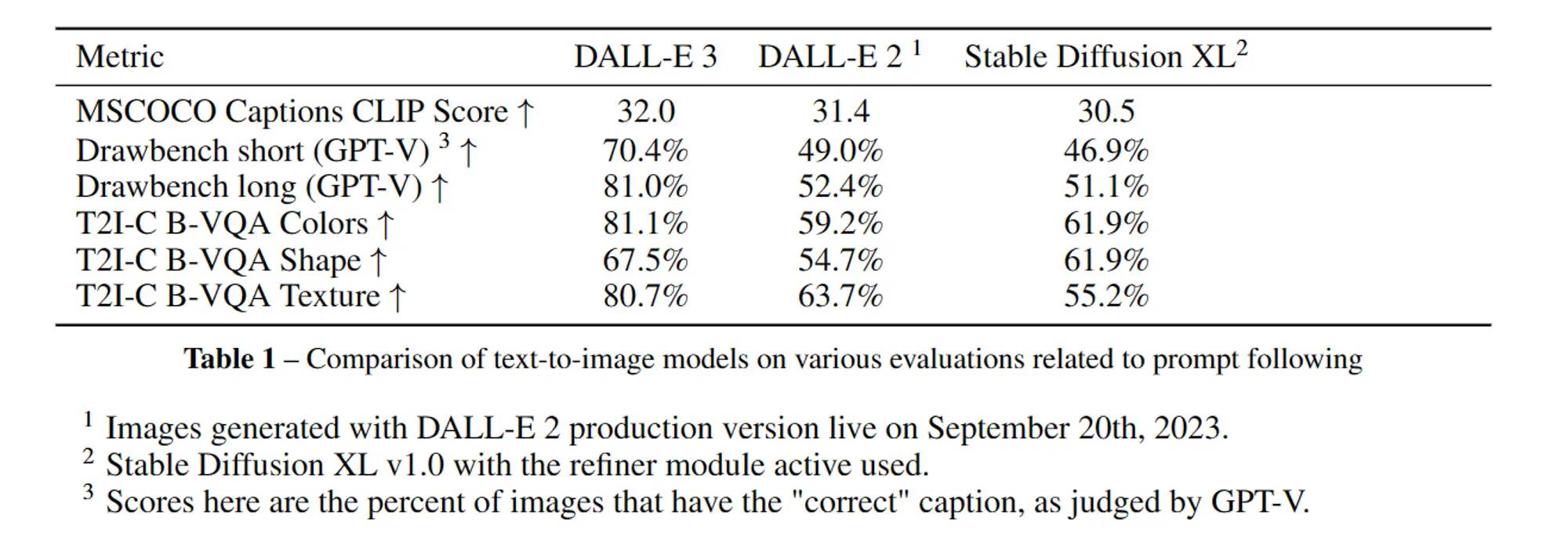

同时还和DALL-E2和SDXL进行了对比测试,可以看到几乎所有的指标都比SDXL要高一些。

Open AI对DALL-E3的评估方式也可以参考一下包括:

自动评估:首先使用公共的ViT-B/32模型计算CLIP分数,然后基于GPT-4V评估模型生成的提示和图像的对应关系,最后在Huang等人(2023年)开发的T2I-CompBench评估套件的一个子集上进行T2I-CompBench评估(包括颜色绑定、形状绑定和纹理绑定三部分)。

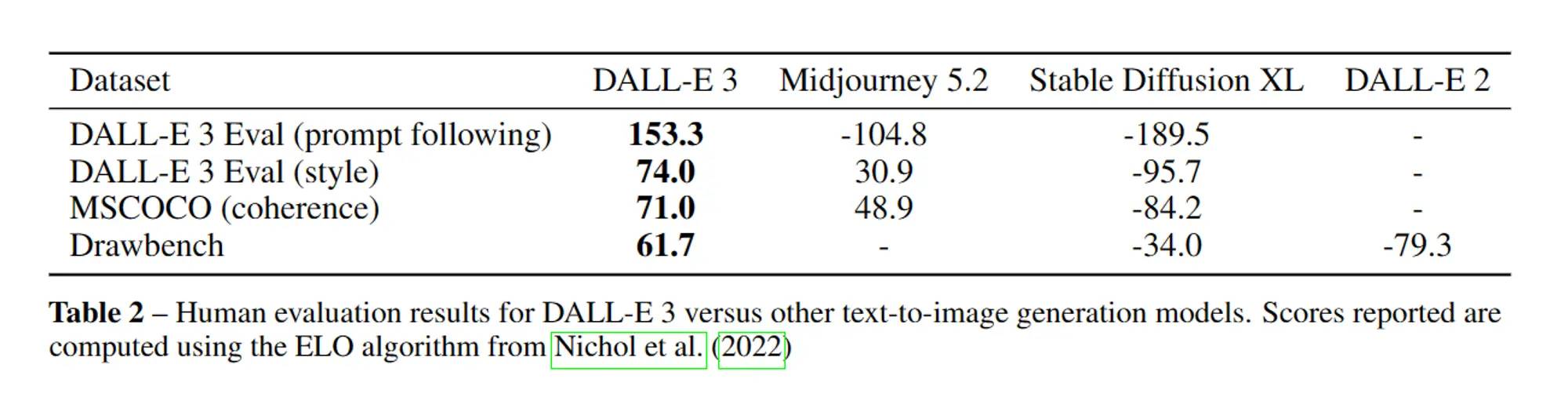

人工评估:评分者被呈现出给予文本到图像模型的完整上采样标题,并被要求“选择哪个图像更符合标题”。想象一下,你正在使用一款电脑工具,根据一些文字生成图像。选择你在使用这个工具时更喜欢看到的图像。连贯性:选择哪个图像包含更连贯的物体。所谓“连贯”的物体是指可能存在的物体。

同时Open AI也承认 DALL-E3再测试中也发现了一些问题:

- 虽然DALL-E 3在根据提示进行生成方面取得了重大进展,但在物体摆放和空间意识方面仍存在困难。(已经比其他模型强太多了)

- 在进行文本生成的时候,单词可能会缺少或多出字符。

- 合成提示很容易在图像中产生重要细节的幻觉。例如,给定一幅植物的绘画,提示生成器经常会幻想出植物的属和种,并将其放入提示中。

© 版权声明

文章版权归作者所有,未经允许请勿转载。