Stable Diffusion稳定生成视频的突破

现在基本所有的SD生成视频都存在稳定性和闪烁的问题,只是有的多有得少。上周发布的这个方案看起来很大程度解决了这个问题。

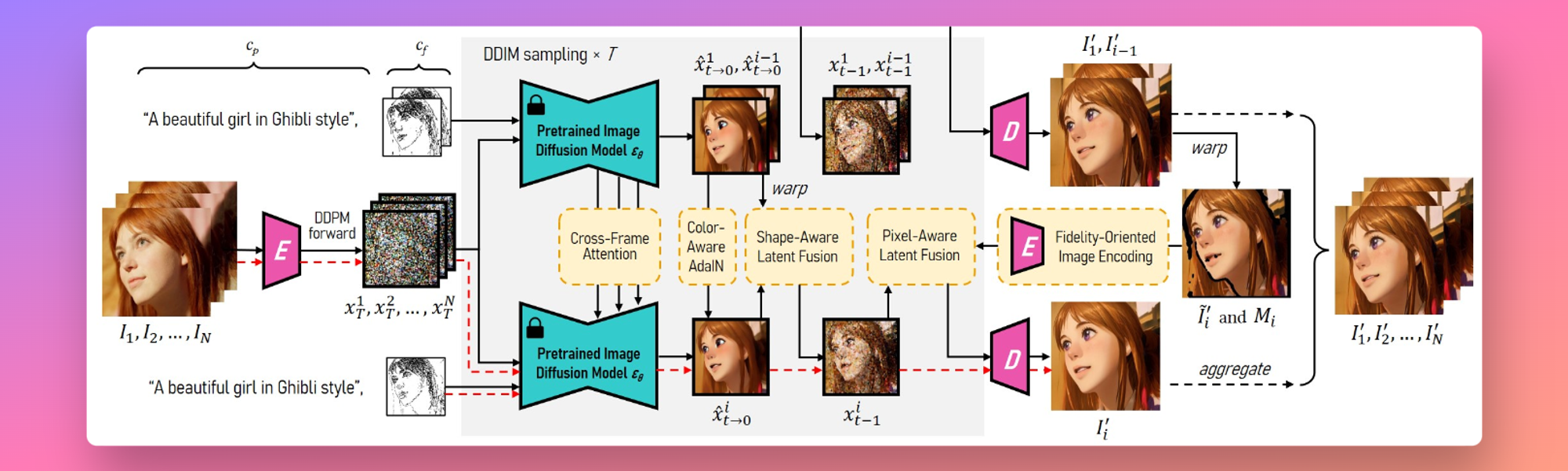

关键帧翻译和完整视频翻译。第一部分使用适应性扩散模型生成关键帧,并应用分层交叉帧约束来强制形状、纹理和颜色的一致性。第二部分通过时间感知的补丁匹配和帧混合将关键帧传播到其他帧。

最重要的是与现有的图像扩散技术兼容,使框架能够利用它们,例如使用LoRA自定义特定主题,并使用ControlNet引入额外的空间引导。

过几天应该会开源可以到时候关注一下。

© 版权声明

文章版权归作者所有,未经允许请勿转载。