Meta 开源了一个名为 Image Bind 的 AI 模型

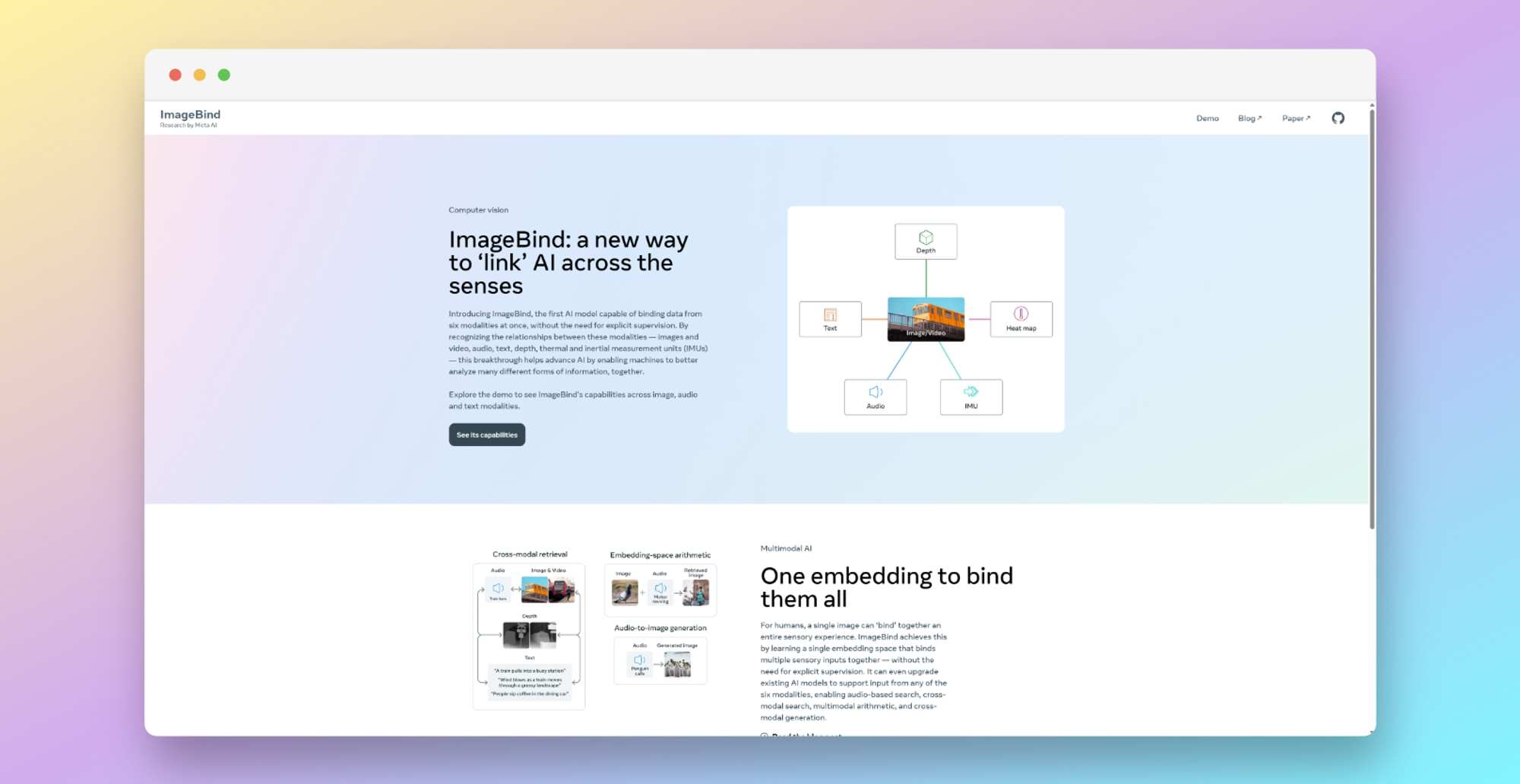

计算机视觉 ImageBind:一种跨感官“链接”人工智能的新方法 ,这是第一个能够同时绑定来自六种模式的数据的 AI 模型,无需明确监督。通过识别这些模式(图像和视频、音频、文本、深度、热和惯性测量单元 (IMU))之间的关系,这一突破通过使机器能够更好地分析许多不同形式的信息来帮助推进人工智能。

通过对齐 6 种模式,你可以做一些用纯文本 GPT-4 做不到的事情:

- 跨模式检索:将其视为多媒体 Google 搜索

- 嵌入空间算法:无缝组合不同的数据格式。

- 生成:通过扩散将任何模态映射到任何其他模态。

图片加载中

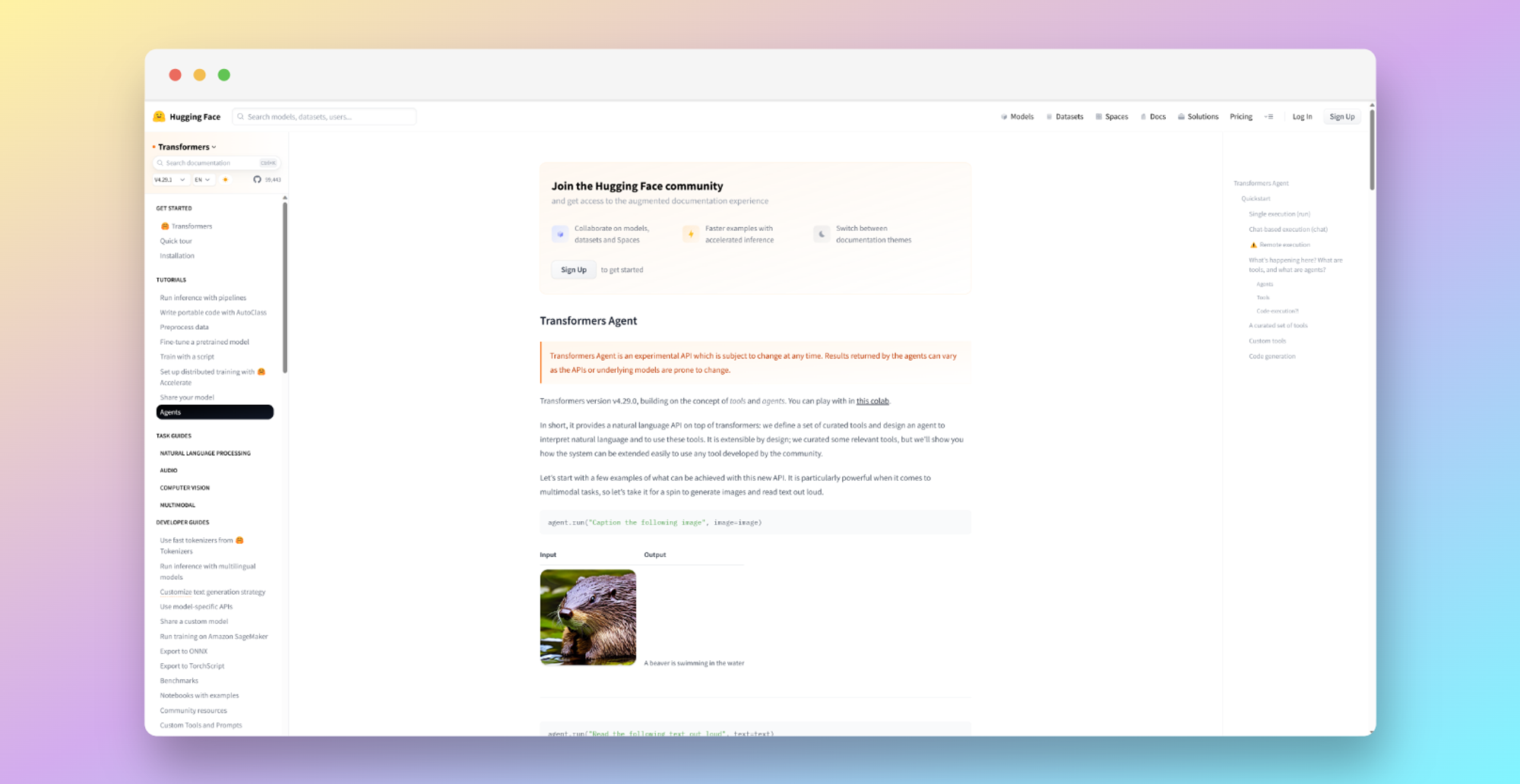

HuggingFace Transformers Agent

HuggingFace Transformers Agent。它使编码 LLM 能够动态组合其他 HF 模型以解决多模态任务。

这个API提供了一个自然语言的API,可在Transformers上定义和设计一组筛选的工具并解释自然语言来使用这些工具。它具有可扩展性,可用于任何由社区开发的工具。它提供了单次运行和聊天执行两种方法,可处理多模态任务。此外,该API还提供了一些预定义的工具,包括文档问答、文本问答、图像生成、图像问答、图像分割、语音转文字、文字转语音、零选择文本分类、文本摘要和翻译等。

图片加载中

© 版权声明

文章版权归作者所有,未经允许请勿转载。